Mi actualidad musical estas semanas está marcada por un nuevo cacharro. Mi aproximación al aprendizaje musical es en general horizontal, asi que suelo pivotar entre intrumentos, tecnología, Ableton Live... y tras dedicar unos meses a la guitarra eléctrica he vuelto a la parte de tecnología, en particular a buscar formas expresivas de hacer música con el ordenador.

Por eso cambié el controlador MIDI hace unas semanas, a uno más orientado a componer, y este mes me he hecho con un cacharro muy interesante que es el Touché, una especie de control de expresión que se diferencia de una palanca o la típica palanca de pitch bend de un controlador en la interacción física.

Esa interacción física es realmente la clave. Hace poco vi un video de Rick Beato, un productor y guitarrista que sigo en YouTube, y tenía por título "The decline of the musical instrument". Interesante ¿no? La tesis inicial del video es que es estúpido comprar colecciones de acordes o de progresiones de acordes MIDI, o incluso trabajar con acordes en la pantalla moviendo cuadraditos con el ratón, cuando puedes hacerlo en un instrumento real, que además es más rápido. Por cierto, el video es un compendio sobre teoría básica para construir acordes y paradójicamente YouTube me puso un anuncio de paquetes de acordes MIDI delante.

En cualquier caso, pasa lo mismo con la expresión de esos acordes. La idea es que la interpretación fisica de un ser humano genera detalles e imperfecciones que se pierden en el ordenador. En Live puedes automatizar cualquier variable a golpe de ratón y teclado, pero ¿qué pasa si lo puedes llevar a algo físico? Esa es la cuestión que quería explorar. Vivimos en una época perfecta para ello porque estamos en medio de una explosión de dispositivos MPE, MIDI 2.0 a la vuelta de la esquina y fabricantes que innovan en esta parte de la "interpretación tecnológica" como por ejemplo Roli o Expressive E la empresa que hace el Touché.

Así que, me he hecho con este arcano dispositivo y bueno, la primera impresión ha sido frustración, sin más. He tenido bastantes problemas para instalar el software que lo acompaña en Mac. De hecho, he estado a punto de devolverlo, pero finalmente el servicio técnico me dió los enlaces de una versión que me podía instalar, y a partir de ahí la verdad es que la experiencia me ha convencido.

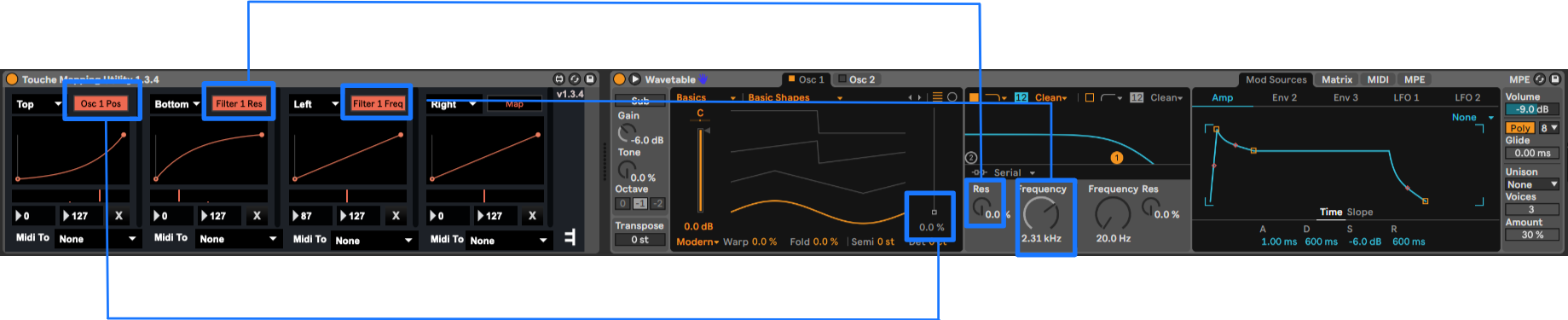

El uso es bastante intuitivo y te das cuenta rápidamente de que la experiencia depende mucho de cómo mapeas y a qué variables. Con los sonidos preparados de Lié (el software que acompaña al dispositivo) todo es muy resultón, pero si coges el plugin de Max for Live (M4L) e intentas mapear a variables de Wavetable por ejemplo, ahí ves que te encuentras un poco perdido. Más aun porque la versión actual parece tener un bug en Live 11 con el primer selector del sensor superior. Solo hay que seleccionar cualquier otro y volver al de top, pero confunde.

Puntos obvios para mapear pueden ser la frecuencia de corte del filtro o la resonancia. El plugin nos permite establecer una curva para describir la evolución de la variable y valores mínimos y máximos. Evidentemente puede meterse en un instrument rack y jugar con otros plugins.

Todo esto hace al touché un cacharro muy versatil, porque se puede usar con Lié que en el fondo es una especie de contenedor de otros plugins, se puede usar integrado en Live a través del plugin M4L y se puede usar con cualquier sintetizador físico a través de MIDI o CV, con lo cual lo podré usar con el Moog Matriarch o el Microfreak. La pega física, es que pierdes la mano izquierda para tocar el teclado, pero supongo que es algo que tienes que aceptar. El siguiente proyecto de la empresa, llamado Osmose, resuelve esto claramente.

Y estas son mis primeras impresiones. Lo dejo ya por hoy, pero antes debo recomendar el documental sobre The Velvet Underground que se ha estrenado esta semana. Tan lisérgico e interesante como sus protagonistas, y sobre todo un ejemplo de creatividad muy inspirador.